최근에 LLM 코딩할 일이 생겨서 이준범님의 KoAlpaca 레포를 보고 스크립트를 따라하고 있다.

https://github.com/Beomi/KoAlpaca

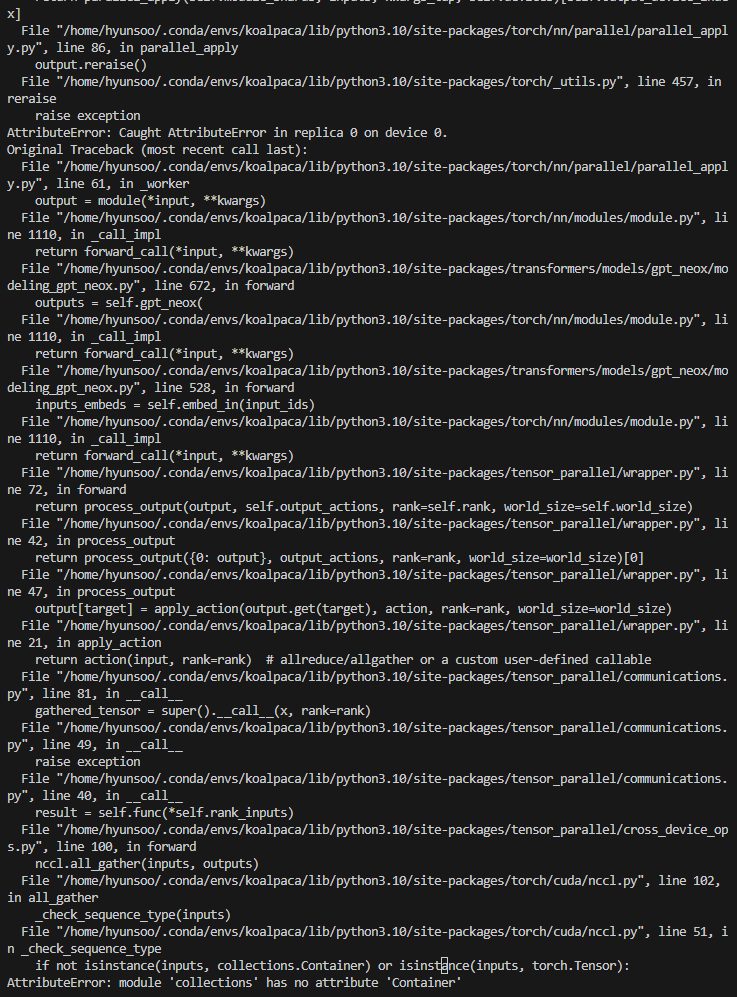

3090 4대를 이용하였고, README에 나와있는대로 진행하였는데, 아래와 같은 오류들이 나왔다.

AttributeError: Caught AttributeError in replica 0 on device 0.

AttributeError: module 'collections' has no attribute 'Container'

해당 오류 이후에 터미널이 꺼지지는 않고 계속 무한 로딩이 지속되었는데, python 버전 문제였다. 3.10 버전이 collections 모듈을 좀 수정한 것 같다.

아무튼 파이썬 버전을 3.9로 내려서 새로 가상환경을 만들어주고 다시 실행하니 잘 작동했다!

참고로 3090은 torch 2.xx 사용이 안되어서 아래 명령어로 설치해야한다.

pip3 install torch==1.11.0+cu113 torchvision==0.12.0+cu113 torchaudio==0.11.0+cu113 -f https://download.pytorch.org/whl/cu113/torch_stable.html

댓글