정말 많이 들어본 Gaussian Splatting.

NeRF도 완벽하게 이해하지 않고, 읽는것이 맞나 싶긴 하지만 관련 연구가 쏟아져나오는 속도 + 2d diffusion을 활용해 3d를 생성하는 연구들에 대한 이해(Dreamfusion, DreamGaussian)를 하기 위해서는 얼른 봐야겠다는 생각이 들었다.

arxiv : https://repo-sam.inria.fr/fungraph/3d-gaussian-splatting/3d_gaussian_splatting_low.pdf

code : https://github.com/graphdeco-inria/gaussian-splatting

1. Introduction

- 논문이 다루는 task : 3D reconstruction

- Input : 2D images

- Output : real time rendering 3D scene

- 해당 task에서 기존 연구 한계점

- NeRF, Mip-NeRF, Mip-NeRF 360 : 시간이 너무 오래걸림

- InstructNGP : inference는 얼마 안걸리지만 Mip-NeRF보다 resolution이 별로임

2. Related Work

출처 : my PPT

3. 제안 방법론

- Main Idea

흐름은 다음과 같다.

입력으로 여러 이미지들을 받고, sfm 알고리즘을 이용해 이 이미지들로 부터 point cloud (initial point)를 만들어낸다.

만들어낸 SfM point들로 3D gaussians을 initialize해주는데, 이때 3D Gaussian은 아래와 같고, M(mean),S(공분산행렬),C(색상),A(투명도)로 parameterize된다. 결국 Gaussian Splatting은 학습을 통해 최적의 M,S,C,A를 찾아 scene을 reconstruct하는 Gaussian들을 구성하는 것이 목표이다.

- Contribution

1. The introduction of anisotropic 3D Gaussians as a high-quality, unstructured representation of radiance fields.

2. An optimization method of 3D Gaussian properties, interleaved with adaptive density control that creates

high-quality representations for captured scenes.

3. A fast, differentiable rendering approach for the GPU, which is visibility-aware, allows anisotropic splatting and

fast back-propagation to achieve high-quality novel view synthesis.

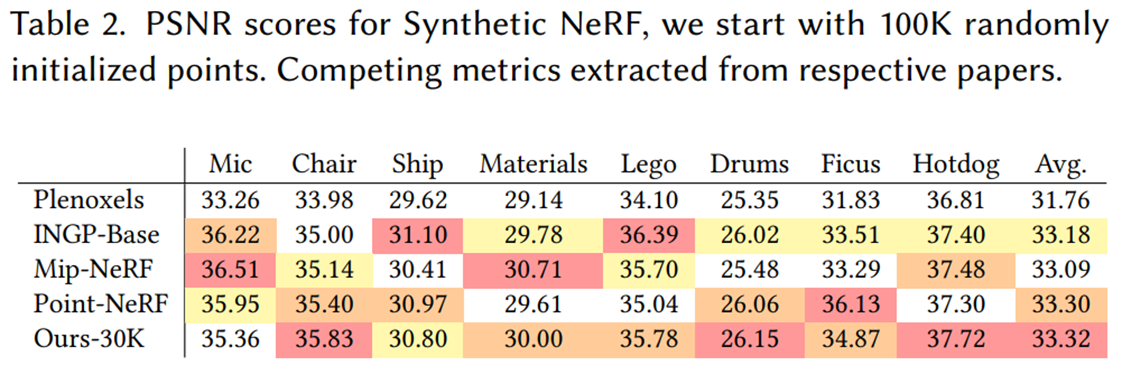

4. 실험 및 결과

- Results

- Conclusion (What I learned)

3DGS가 뭔지 거의 이해했...지만 얘가 왜 빠른지 rasterization 부분은 아직 명료하게 이해되진 않는다.

직접 코드를 돌려보고 + graphics 지식을 좀 더 공부해봐야 할 것 같은데, 3D 연구를 하게되면 다시 봐야겠다..

댓글